txt2imgで画像を生成し、img2imgで仕上げる流れに慣れてきた頃、こんな「壁」にぶつかることはないでしょうか。

- 同じポーズで別の服装にしたいのに、どうしてもポーズが変わってしまう

- 参考画像と同じ構図にしたいのに、プロンプトを何度書き直しても再現できない

- せっかく決まった輪郭や奥行きを固定したまま、画風だけを変えたい

どれだけ呪文(プロンプト)を工夫しても、AIの出力は毎回異なる「解釈」に左右されます。テキストだけで構図やポーズを100%意図通りに固定するのは、本質的に難しいのです。

その限界を突破し、「生成ガチャ」を卒業するための決定打となるのが ControlNet(コントロールネット) です。

プロンプトが「言葉による指示」なら、ControlNetは「画像による精密な設計図」。

画像という「視覚的な設計図」をAIに渡すことでポーズ、輪郭、奥行きを精密にコントロールできるようになります。

本記事では、RTX 5070のパワーとVRAM 12GBという最新環境をフルに活かし、主要な3モデル Canny・Depth・OpenPose の機能を実際に試しながら、設定値の意味から実践テクニックまでを丁寧に解説していきます。

複雑に見える設定値の意味から、Hires.fixやADetailerと組み合わせた「最強のフルコース」運用まで、この記事一つで「AIを意図通りに操る技術」をマスターしましょう!

このシリーズの関連記事

UruruAILab

ControlNetとは何か

Stable Diffusionを始めたけれど、プロンプトだけではどうしても思い通りのポーズや構図にならない…

そんな悩みを一瞬で解決し、画像生成の自由度を別次元へ引き上げてくれるのが、最強の拡張機能「ControlNet(コントロールネット)」です。

ここでは、そもそもControlNetがどんな仕組みなのか、何ができるのかを、初心者の方にもわかりやすく噛み砕いて解説します。

プロンプトでは伝えられない「構造情報」を渡す仕組み

これまでStable Diffusion(Forge)を使っていて、こんな経験はありませんか?

「右手を腰に当てて、少しだけ前傾姿勢で、首を傾けて……」と、必死にプロンプトをひねり出しても、出てくるのはなぜか手が3本あったり、体が不自然にねじれた画像ばかり。言葉だけで「正確なポーズや配置」を伝えるには、限界があります。

その限界を突破する魔法のツールが、ControlNet(コントロールネット)です。

ControlNetを一言でいうと、AIに「下書き(ガイド)」を渡す仕組みのこと。

テキスト(プロンプト)という「曖昧な言葉」の代わりに、画像という「確定した形」をAIに見せることで、「ここにはこの線を引いて」「ここは奥行きを持たせて」と、まるで現場監督のようにAIへ指示を出せるようになります。

これを使えば、今まで何十回も回していた「生成ガチャ」から卒業し、1発で理想の構図を手に入れることができるようになります。

ControlNetでできること一覧

「ControlNetって種類が多すぎて、どれを使えばいいかわからない……」という方も多いはず。まずは、これだけ覚えておけば間違いない「三種の神器」をご紹介します。

| モデル名 | 抽出する情報 | どんな時に使う?(主な使いどころ) |

|---|---|---|

| Canny | 輪郭線・エッジ | 「この服の模様を絶対に変えたくない!」という時や、 線画から色塗りをしたい時。 |

| Depth | 奥行き・立体感 | 「ポーズはそのままで、服のデザインだけをガラッと変えたい!」という時。 |

| OpenPose | 人体の骨格・関節 | 「とにかく複雑なポーズをピタッと固定したい!」という時。指先の制御にも。 |

ControlNetの導入と基本操作

「ControlNetが凄いのはわかった。でも、設定が難しそう……」と身構える必要はありません。

特にStability Matrixを使っているなら、拍子抜けするほど簡単に導入が終わります。

ここでは、最新のSDXL環境でControlNetを最短で使い始めるための手順を、実際の画面を見ながら確認していきましょう。

Stability MatrixでのControlNetモデルの入れ方

まずは、AIに「どんな下書きを描けばいいか」を教えるためのモデルデータを準備します。

以前のように、わざわざブラウザで配布サイトを探して、複雑なフォルダにファイルを放り込む……なんて苦労はもう不要です。

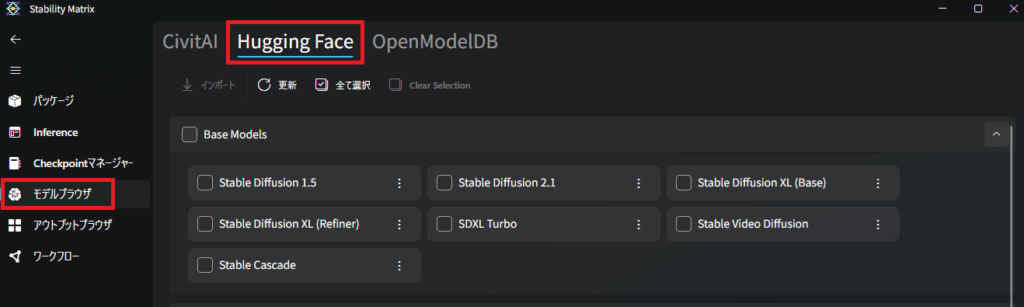

Stability Matrixを立ち上げたら、左メニューの「モデルブラウザ」をクリック。

上部のタブを「Hugging Face」に切り替えます。

下へスクロールしていくと、「ControlNets(SDXL)」という項目が出てきます。

今回は、アニメ系の生成に強くて動きも軽い「Kohya Control-lllite」シリーズを選んでおけば間違いありません。

今回ダウンロードするモデル(SDXLアニメ系推奨)

Kohya Control-lllite Canny (Anime)Kohya Control-lllite Depth (Anime)Kohya Control-lllite Openpose (Anime)

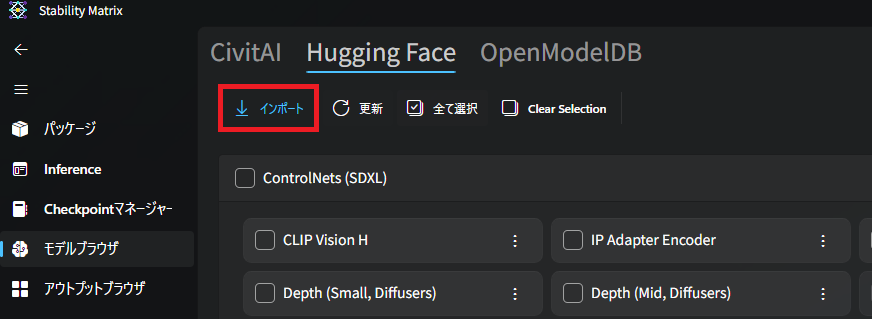

使いたいモデルにチェックを入れたら、画面上の「インポート」ボタンを押すだけ。

あとはツール側で勝手に「いつもの場所」に保存してくれます。

もしForgeを立ち上げっぱなしにしていたなら、一度閉じて再起動してください。これで準備完了です!

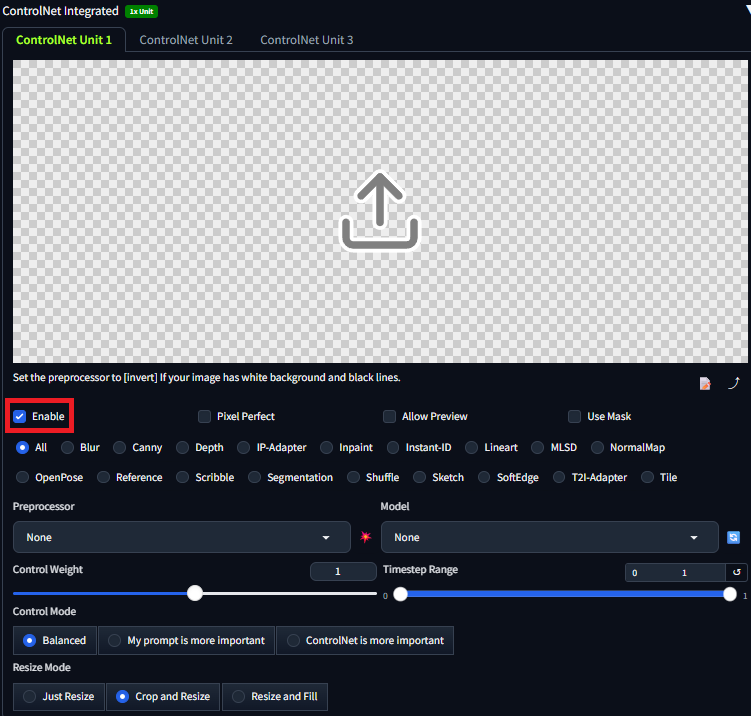

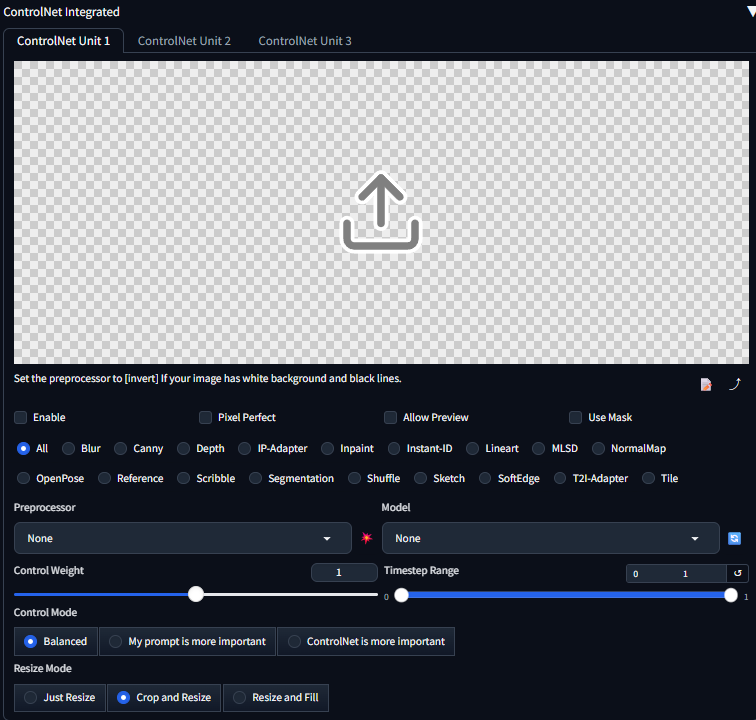

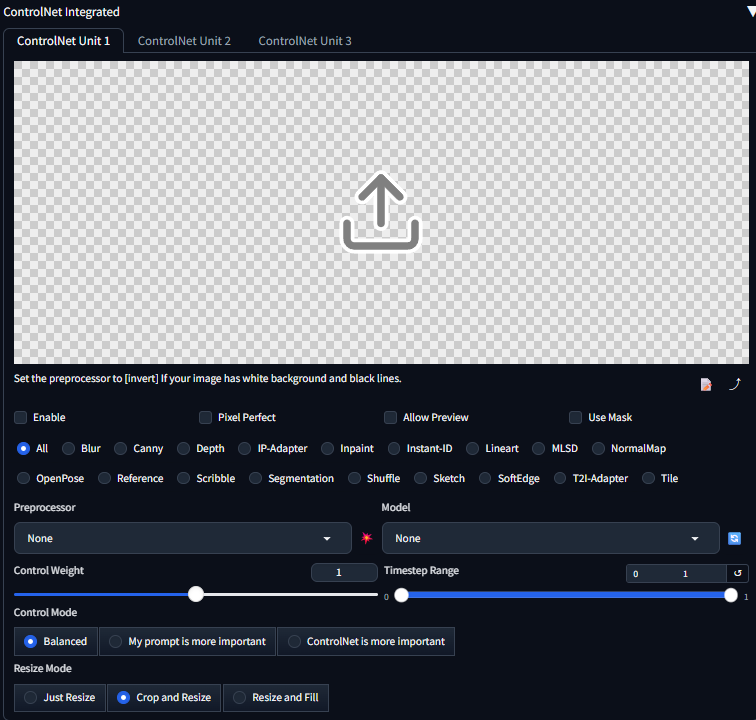

ForgeでのControlNetの開き方・画面説明

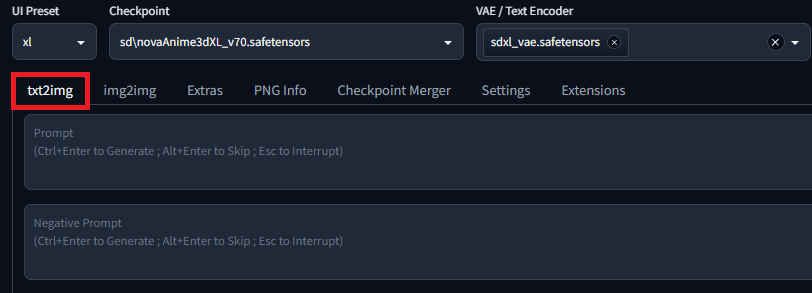

モデルが準備できたら、いよいよForgeの画面でControlNetを呼び出しましょう。

Forgeは最初からControlNetが入っているのが嬉しいところですが、パネルが少し隠れた場所にあるので見落とし注意です。

いつも通りForgeを起動したら、「txt2img」(または画像から作るなら「img2img」)タブを開きます。

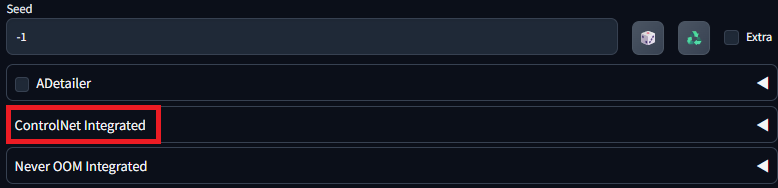

プロンプト入力欄の下の方へスクロールしていくと、「ControlNet Integrated」という名前のパネルがひっそりと隠れています。

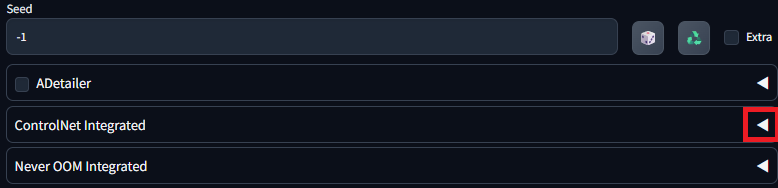

右端にある「◀」ボタンをクリックして、パネルの中身を展開しましょう。

ここが、画像生成を自分の意図通りに操るための「コックピット」になります。

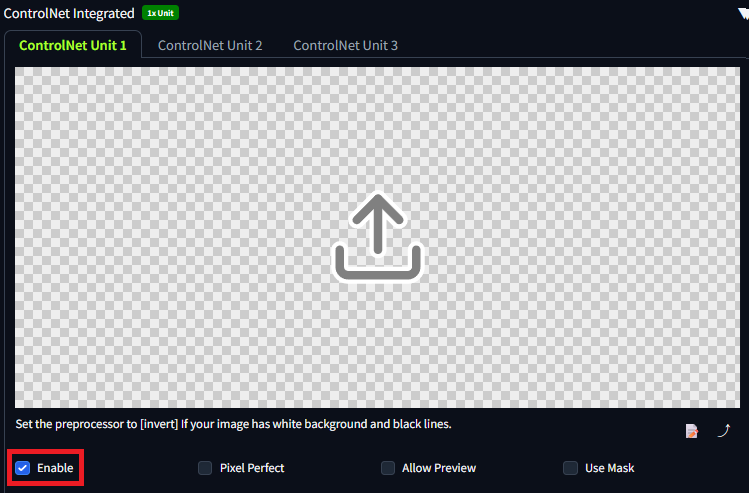

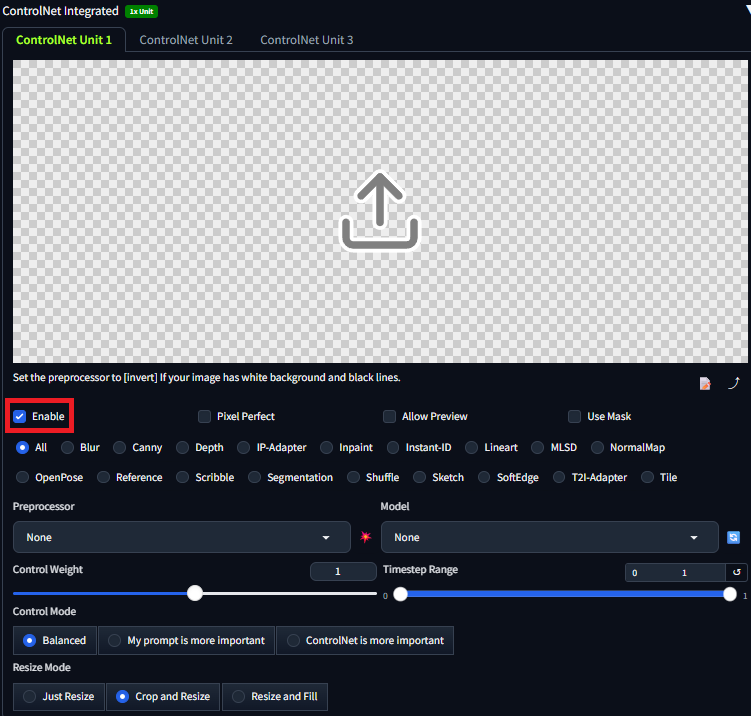

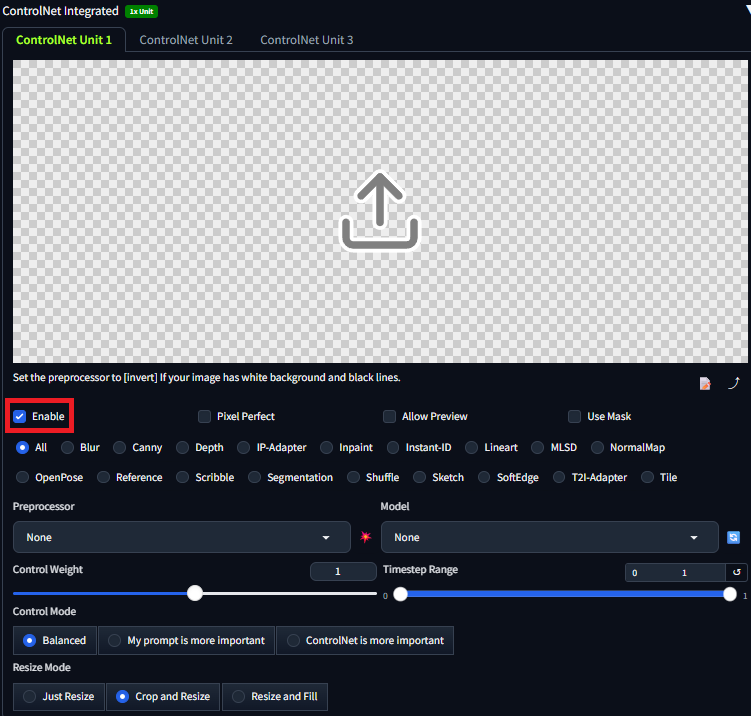

ここが一番の注意ポイントです。

パネル内の左下にある「Enable(有効にする)」に必ずチェックを入れてください。 これにチェックが入っていないと、どんなに設定をいじってもControlNetは1ミリも動いてくれません。「あれ、効かないな?」と思ったら、まずはここを疑うのが鉄則です!

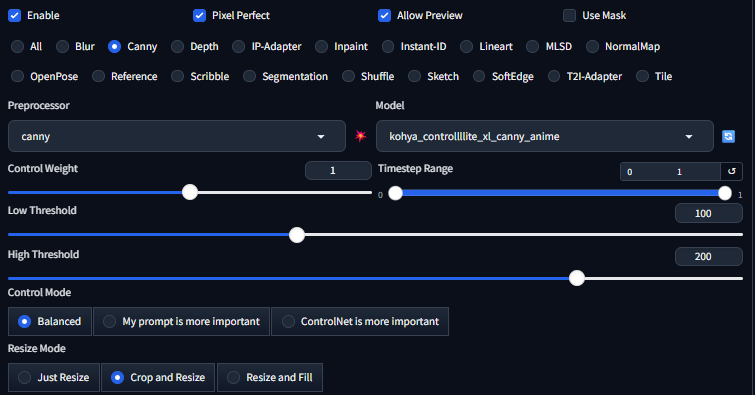

ControlNetの共通設定値を理解する

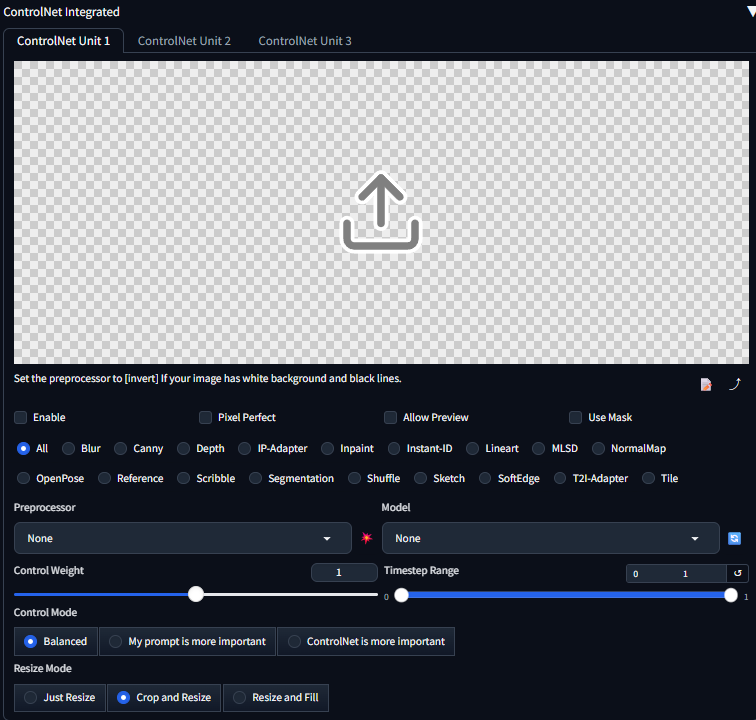

ControlNetのパネルを開くと、ズラッと並んだチェックボックスやスライダーを前に「うわっ、難しそう……」と身構えてしまうかもしれません。でも、安心してください。実際に触るべき重要ポイントは、実はそれほど多くありません。

どのモデル(CannyやDepthなど)を使う場合でも共通して必要になる、基本の設定からマスターしていきましょう。

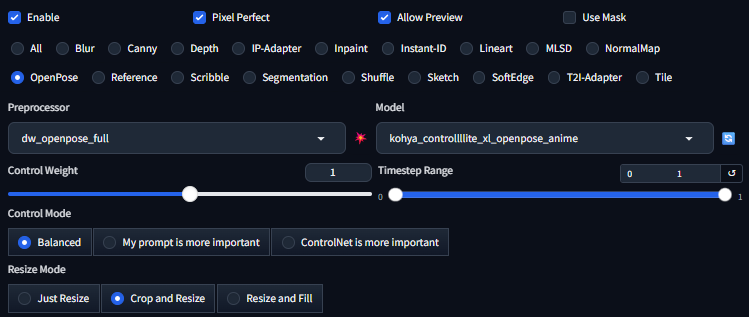

Enable・Pixel Perfect・Allow Preview・Use Mask

まずはパネル上部にある、いわば「基本のスイッチ」たちです。ここは「とりあえずこれを入れておけばOK」という鉄板の設定があります。

- Enable(有効化)

ControlNetを動かすためのメインスイッチです。「あれ、設定したのに効かないな?」と思ったら、まずここを確認してください。

ちなみに、チェックを外せば設定を残したまま無効化できるので、ControlNet「あり・なし」の比較画像を作る時にも重宝します。 - Pixel Perfect(ピクセル完全一致)

以前の環境では手動で計算が必要だった難しい設定を、AIが自動で「今の画像サイズに最適な設定」に調整してくれる神機能です。

迷わずONでOK。 解像度のミスマッチによる画質の低下を、賢く防いでくれます。 - Allow Preview(プレビュー許可)

これにチェックを入れると、AIが「今こんな下書き(エッジマップなど)を作りましたよ」とプレビューを見せてくれます。自分の意図通りに線が取れているか、生成前にカンニングできるのでオンにしておくと安心です。 - Use Mask(マスクの使用)

画像の一部だけにControlNetを効かせるための、ちょっと高度な機能です。

初心者のうちは、チェックを外したままで全く問題ありません。 むしろ、下手に触ると「意図しない部分にだけ線が適用される」といった混乱の元になるので、まずは「スルー」が正解です。

Low VRAM(低VRAMモード)がない?

以前の解説サイトや古い情報では必ずと言っていいほど登場した「Low VRAM」ですが、最新の環境では「項目自体が表示されない」、あるいは「設定不要」なケースが増えています。

この設定は、以前の世代のGPU(3070 Ti以前など)でメモリ不足エラーを回避するための「救済措置」でした。

今の強力なPC環境なら、制限なしのフルスピードで生成を楽しめるという証拠ですので、安心してそのまま進めてOKです。

Preprocessor(プリプロセッサ)とModel(モデル)

ontrolNetを動かすには、「情報を抜き出す人」と「情報を絵に反映させる人」の二人三脚が必要です。

この2つの設定が正しく組み合わさることで、初めて「思い通りの制御」ができるようになります。

| 項目 | Preprocessor(プリプロセッサ) | Model(モデル) |

|---|---|---|

| イメージ | 「塗り絵の線」を引く人 | 「線からはみ出さないよう」に塗る人 |

| 役割 | あなたが渡した画像から、AIが理解できる「ヒント(線や奥行き)」を抜き出す。 | 抜き出されたヒントを頼りに、プロンプトの指示通りに絵を完成させる。 |

| 操作のコツ | 基本はやりたい手法(Canny等)を選ぶ。※すでに自作の線画がある場合は「None」にする。 | Preprocessorと同じ名前のものを選ぶのが鉄則。(例:CannyならCanny用モデル) |

| もし間違えると? | AIがどこを基準に描けばいいか分からず、形が崩れる。 | ガイドを無視して、いつもの「生成ガチャ」に戻ってしまう。 |

Control Weight(強度)

ControlNetの影響力を決める、いわば「AIへの命令の強さ」です。

スライダーを左右に動かすだけで、下書き(コントロール画像)の指示をどれくらい厳密に守らせるかを調整できます。デフォルトは「1.0」ですが、状況に合わせて微調整するのが「脱・初心者」への第一歩です。

| 数値 | 挙動(AIの反応) | どんな時に使う? |

|---|---|---|

| 0.3〜0.6 | AIの自由度が高め。 「下書きは参考程度」という状態。 | 構図の雰囲気だけ借りて、中身はAIに任せたいとき。 |

| 0.7〜1.0 | 王道のバランス。 構造をしっかり守りつつ、AIらしい綺麗な描き込みも両立。 | 初心者はまずここから! 迷ったらこの範囲。 |

| 1.1〜1.5 | 下書きの線を「絶対死守」させる、強い拘束力。 | ポーズや輪郭を1ミリも動かしたくない、厳密な再現を狙うとき。 |

| 1.5以上 | 命令が強すぎて、画像がノイズでガタつく(破綻する)ことも。 | 特殊なこだわりがある上級者向け。 |

Timestep Range(開始・終了ステップ)

ControlNetの設定の中でも、少し概念的なのがこの「Timestep Range」です。

これは「AIがノイズから画像を作り上げる『時間軸』を、どのタイミングでControlNetに口出しをさせるか」を決めるものです。

スライダーの左側が「開始」、右側が「終了」を意味しています。

- 左側の数値(開始):デフォルトは「0」

AIが真っさらな状態から描き始める「一番最初」からControlNetを効かせます。

基本はこの「0」のままでOKです。全体の構図を固める大事な時期なので、最初からガイドを見せておきましょう。 - 右側の数値(終了):デフォルトは「1」

AIが描き終える最後のステップまで、ControlNetが付きっきりで指導します。ほとんどの場合は「1」で問題ありません。

Control Mode(プロンプトとのバランス)

「自分が書いたプロンプト(言葉)」と「ControlNetの下書き(形)」、どちらをより優先するかという指示のバランスを決める設定です。 AIの中で行われている「言葉 vs 線」のせめぎ合いを、この3つのモードで調整します。

| モード(選択肢) | 挙動(AIの優先度) | どんな時に選ぶ?(使いどころ) |

|---|---|---|

| Balanced | 言葉と線のバランスを、AIがちょうど良く取ってくれます。 | 迷ったらこれ! 基本はこのままでOKです。 |

| My prompt is more important | 「言葉」の指示を優先。下書きの形は少し甘くなります。 | 色使いや服の質感など、プロンプトのイメージを強く出したい時。 |

| ControlNet is more important | 「下書き」を絶対死守。プロンプトが多少無視されることも。 | ポーズや構図を1ミリも動かしたくない時。 |

Resize Mode

「読み込んだ下書き画像」と「これから生成するサイズ」が食い違っているとき、AIがその差をどう埋めるかを決める設定です。ここの選択を間違えると、せっかくの美少女が太ってしまったり、逆に細長くなったりして台無しになってしまいます。

| モード(選択肢) | 挙動(AIの優先度) | どんな時に選ぶ?(使いどころ) |

|---|---|---|

| Just Resize | 画像を無理やり引き伸ばして、指定サイズにねじ込みます。 | 非推奨。 画像が歪んで、「縦伸び・横伸び」してしまいます。 |

| Crop and Resize | ちょうどいいサイズになるように、中央を基準に端を切り抜きます。 | 鉄板の設定! 比率が違っても画像が歪まないので、基本はこれ一択です。 |

| Resize and Fill | 足りない隙間を背景などで補い、元の比率を維持したまま収めます。 | 構図を1ミリも削りたくない、特殊なこだわりがある時に。 |

Cannyの使い方:形状を精密に維持する

ControlNetの中で最も標準的、かつ信頼性の高いモデルがこのCanny(キャニー)です。 一言でいえば、「元画像から輪郭線(エッジ)を抽出し、その形を崩さずに新しい画像を生成する機能」です。

「構図は気に入っているけれど、画風だけを変えたい」「服の細かいデザインをAIに勝手に描き換えられたくない」という場面で、非常に強力な力を発揮します。

Cannyとは:輪郭線(エッジ)から「形」を固定する

Cannyは、画像の中から色の変化が激しい部分を「境界線」として認識します。

この抽出された線が、生成時の強力なガイドライン(下書き)となるため、AIは「この線からはみ出さないように描画する」という制約を受けます。

その結果、以下のような制御が可能になります。

- キャラクターの再現

顔立ちやポーズを維持したまま、別モデルでの描き直しができる。 - 構造の維持

建物の窓の位置や、背景のパース(遠近感)を固定したまま雰囲気を変えられる。 - 線画の活用

自分で描いたラフや線画を元に、質感や色味だけをAIに任せられる。

Cannyのおすすめ使いどころ

Cannyの最大の特徴は、とにかく「元の形を守る力が強い」ことです。

具体的な活用シーンをまとめました。

| 活用シーン | 具体的な効果 |

|---|---|

| スタイル変換 | 実写風の画像を、構図を一切変えずにアニメ調や油絵風へ変換する。 |

| 背景・建物の固定 | 建物の外観を保ったまま、季節(夏→冬)や時間帯(昼→夜)を変更する。 |

| ラフ・線画の清書 | 手書きのラフ画像を読み込ませ、AIの画力で高品質なイラストへ仕上げる。 |

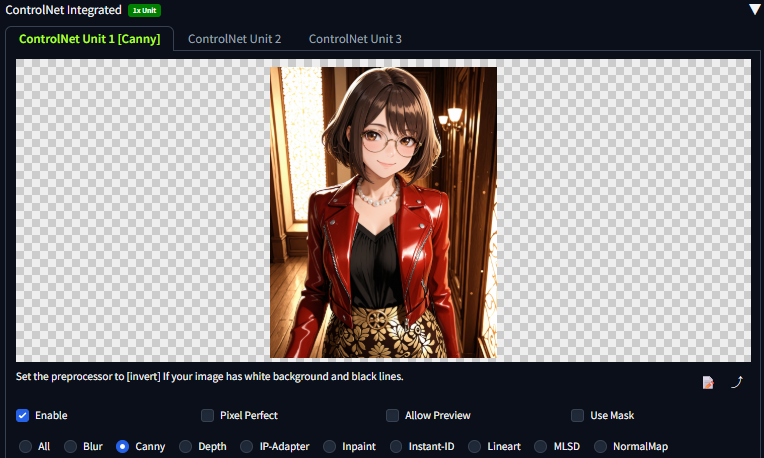

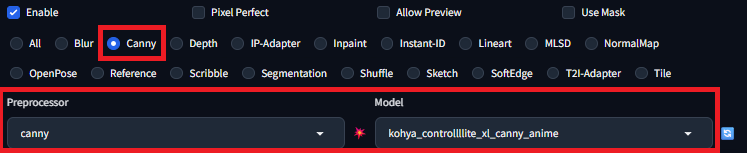

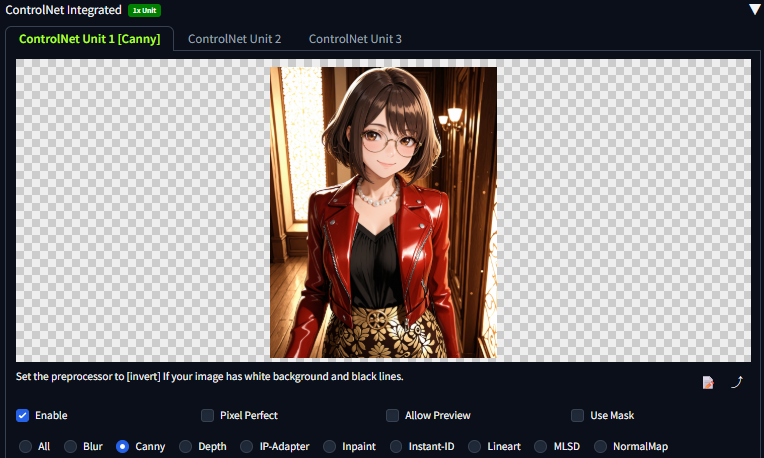

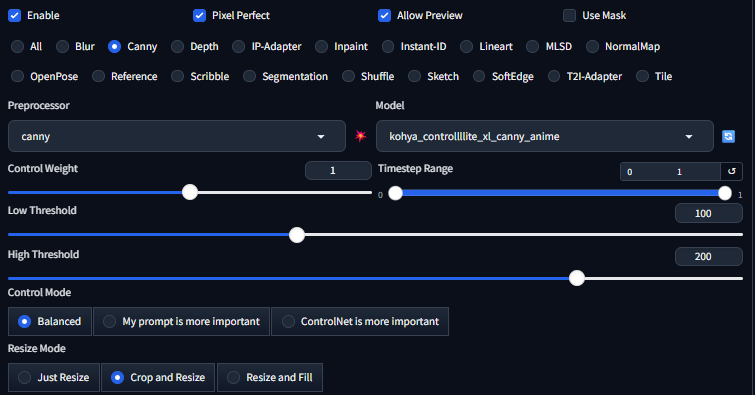

Cannyの実践手順

設定項目は多いですが、実際に調整が必要な場所は限られています。

Forgeでの基本的な操作の流れです。

ControlNet Integrated のパネルを開きます。

まずここをONにします。設定を終えてもここを忘れると機能しないため、最初に行う習慣をつけましょう。

輪郭を抽出したい(下書きにしたい)画像をセットします。

画面上部の Canny ボタンを押します。

これで、適切な Preprocessor と Model が一括で自動選択されます。

今回のModelは、kohya_controllllite_xl_canny_animeを選択します。

今回は、以下の設定で進めます。

- Pixel Perfect:ON

- Allow Preview:ON

- Control Weight:1.0

- Timestep Range:0~1

- Threshold (Low/High):100 / 200

- Control Mode:Balanced

- Resize Mode:Crop and Resize

プロンプトを入力し、「Generate」をクリックして結果を確認します。

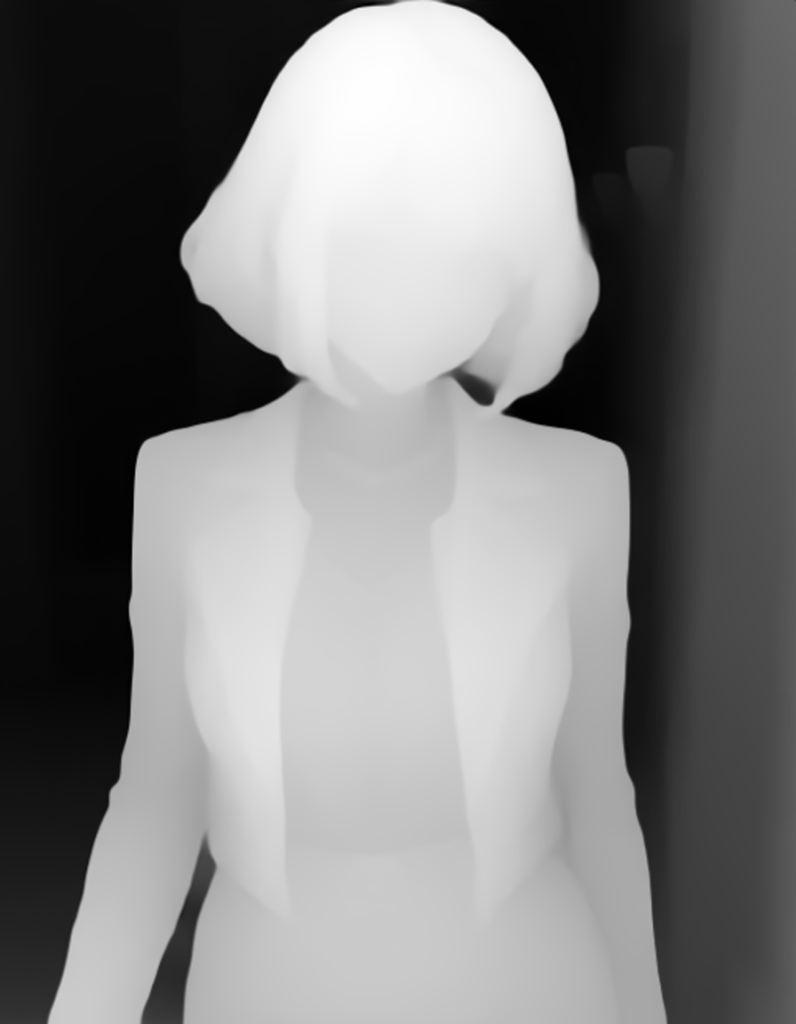

元の画像

抽出した画像

Cannyのコツと注意点:仕上がりの「硬さ」を解消する

Cannyは非常に忠実に線を守るため、少しの工夫で仕上がりのクオリティが大きく変わります。

- プレビュー機能で「線」の状態を確認する

Preprocessorの横にある「火花マーク」を押すと、AIが抽出した輪郭線(エッジマップ)を確認できます。線が多すぎて真っ白な場合は、しきい値(Threshold)を上げて線を間引くと、AIが色や質感を表現する余白が生まれ、綺麗な結果になりやすいです。 - 細かいノイズや柄の影響を避ける

Cannyは元画像にある細かいシワや模様もすべて「線」として拾う性質があります。あまりに情報量が多いと、アニメ調にしたい時でも実写特有の生々しさが残ってしまうことがあります。「残したい輪郭だけがシンプルに出ている状態」を目指すのが、成功への近道です。 - 重みを下げて「遊び」を作る

生成された画像が「塗り絵」のように線が目立ちすぎて硬いと感じたら、Control Weight を 0.7 〜 0.8 程度に下げてみてください。 線の束縛を少し緩めることで、AIが得意とする「柔らかい質感」や「自然な光の当たり方」が反映されやすくなり、一気に画像が垢抜けます。

Depthの使い方:立体感と空間を制御する

Cannyが「線の形」で画像を縛るのに対し、このDepth(デプス)は、画像から「奥行き・距離感(深度マップ)」を抽出して構図を固定するモデルです。

「キャラクターのポーズや立体感は維持したいけれど、服装や細部のデザインはAIに自由に描き替えてほしい」といった場面で、Canny以上に柔軟で自然な結果をもたらしてくれます。

Depthとは:距離の情報で「空間の構造」を固定する

Depthは、元画像の中にある物体が「カメラからどれくらい離れているか」を解析し、それを白黒の濃淡で表した「深度マップ」を作成します。手前にあるものほど白く、奥にあるものほど黒く表現されます。

Cannyとの大きな違いは、「細かい輪郭を追わない」という点です。 輪郭線に縛られないため、キャラクターの体格や空間の広がりといった「ボリューム感」を維持したまま、中身のデザインをガラリと変えることが得意です。

Depthのおすすめ使いどころ

Depthは「大まかな構図は守るが、細部はAIに任せる」という使い方が最も効果的です。

| 活用シーン | 具体的な効果 |

|---|---|

| キャラクター変換 | ポーズの立体感や体格を維持したまま、別の衣装やキャラクターへ自然に描き替える。 |

| 背景の空間維持 | 部屋の奥行きや家具の配置を固定したまま、インテリアのデザインや壁紙だけを変更する。 |

| 複数人の配置維持 | 人物同士の前後関係や距離感を守りつつ、全体の画風を統一して生成する。 |

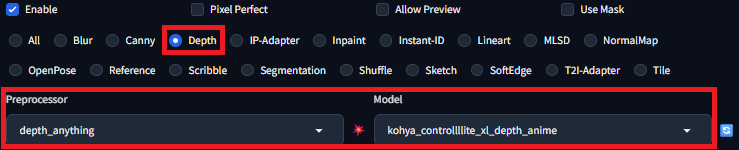

Depthの実践手順

Depthの設定で最も大切なのは、AIに「どこが手前で、どこが奥か」を正確に理解させることです。

Forgeでの基本的な操作の流れです。

ControlNet Integrated のパネルを開きます。

まずここをONにします。設定を終えてもここを忘れると機能しないため、最初に行う習慣をつけましょう。

奥行き情報を抜き出したい画像をセットします。

画面上部の Depthボタンを押します。これで、適切な Preprocessor と Model が一括で自動選択されます。

今回のModelは、kohya_controllllite_xl_depth_animeを選択します。

今回は、以下の設定で進めます。

- Pixel Perfect:ON

- Allow Preview:ON

- Control Weight:1.0

- Timestep Range:0~1

- Control Mode:Balanced

- Resize Mode:Crop and Resize

プロンプトを入力し、「Generate」をクリックして結果を確認します。

元の画像

抽出した画像

Depthのコツと注意点:Cannyとの使い分けが鍵

Depthを使いこなすために、その「性質」を理解しておきましょう。

- 細部のデザインは「変わる」ことを前提にする

Depthは空間構造を優先するため、キャラクターの指先、アクセサリーの形、服の細かいフリルといった「薄いもの」や「細かいもの」の維持は苦手です。これらを正確に残したい場合はCannyを、逆に「ネックレスを服の中に埋もれさせたい」といった、立体的な整合性を優先したい場合はDepthを選ぶのが正解です。 - 上級テク:CannyとDepthの「同時使用」

「形も守りたいし、空間の立体感も出したい」という欲張りな要求には、2つのControlNetユニットを同時に使う方法があります。 本来ならVRAMを多く消費する力技ですが、RTX 5070の12GB VRAMがあれば、速度を落とさず余裕を持って動作させることが可能です。 - 重みを下げて「遊び」を作る

生成された画像が「塗り絵」のように線が目立ちすぎて硬いと感じたら、Control Weight を 0.7 〜 0.8 程度に下げてみてください。 線の束縛を少し緩めることで、AIが得意とする「柔らかい質感」や「自然な光の当たり方」が反映されやすくなり、一気に画像が垢抜けます。

どっちを使う?CannyとDepth使い分け決定版

ここまでCannyとDepth、それぞれの特徴を見てきましたが、「結局、自分の作りたい絵にはどっちが最適なの?」と迷う方も多いはずです。

どちらも「元画像の構造を守る」という点では共通していますが、「何を守り、どこに自由を与えるか」という設計思想が根本的に異なります。

「輪郭」のCannyか「ボリューム」のDepthか

一言で言えば、以下のような基準で使い分けるのがスムーズです。

- Canny:形状の固定(この形・この線を守りたい)

「線」そのものをガイドにするため、服のシワ、キャラクターの細かい顔立ち、複雑な装飾品など、目に見える境界線を厳密に維持したい時に使います。 - Depth:空間の固定(この立体感・この前後関係を守りたい)

「ボリューム(塊)」として空間を捉えるため、大まかなポーズや奥行きは維持しつつ、服の質感や細かいデザインをAIに描き直させたい(自由度を与えたい)時に適しています。

逆引き表:やりたいこと別おすすめ早見表

作業中にいつでも見返せるよう、目的別の使い分けを表にまとめました。

基本的にはこの「おすすめ」から試してみるのが、理想の1枚への近道です。

| やりたいこと | おすすめ | 理由 |

|---|---|---|

| 服のデザインを固定したい | Canny | 服の輪郭線(エッジ)を保ったまま再生成できるため。 |

| 背景の雰囲気だけ変えたい | Depth | 建物のパースや空間の奥行きを保ったまま変換できるため。 |

| 別のキャラクターに変換したい | Depth | ポーズの立体感だけを引き継ぎ、細部はAIに任せやすいため。 |

| ラフ画や線画を清書したい | Canny | 描いた線の構造をそのまま活かして彩色できるため。 |

| 複数人の前後関係を維持したい | Depth | 奥行き情報(距離感)で位置関係が固定されるため。 |

| 建物・物体の形を厳密に維持したい | Canny | エッジが明確な被写体の再現に強いため。 |

| 髪型・顔の輪郭を維持したい | Canny | 細かい境界線の再現に長けているため。 |

| ポーズの立体感だけ参考にしたい | Depth | 細部が変わっても「塊」としてのボリューム感が維持されるため。 |

実例比較:プロンプトだけで「着せ替え」と「画風変更」を両立する

「やりたいこと」が見えてきたところで、実際に画像がどう変化するのか、具体的な比較を見てみましょう。

今回はあえてチェックポイント(モデル)を一切変更せず、プロンプトの書き換えだけで「フォトリアル」から「アニメ調のイラスト」への変換、そして衣装の着せ替えに挑戦しました。

元画像(Base Image)

ベースは、赤いレザージャケットと眼鏡が特徴的なフォトリアルな女性像です。背景の重厚なウッドパネルや照明など、実写ならではの情報量が詰まった1枚です。

比較結果:Cannyか、Depthか

Canny:形状を「死守」して色を変える

プロンプトに「アニメ調(anime style)」と「緑のレザージャケット(green leather jacket)」を加え、Cannyを適用した結果です。

- 特徴:「線」を完璧にトレースします。

- 結果:プロンプトで「アニメ調」と指示しても、ジャケットの縫い目やジッパーの線を強烈に維持。実写の構造をそのままアニメ塗りにしたような、再現度の高い画像になります。

Depth:ボリュームを「継承」して大胆に変身

プロンプトに「アニメ調(anime style)」と「白いタートルネックニット(white turtleneck sweater)」を加え、Depthを適用した結果です。

- 特徴:「奥行き(面)」のみを抽出します。

- 結果:レザージャケット特有の「線の縛り」がないため、AIが空間情報だけを守りつつ、厚手のニットへ大胆に作り変えることができました。背景がスッキリしたのも、Depthが不要な線を無視した結果です。

最終判断基準:再現度か、クオリティか

CannyとDepth、どちらを選ぶべきかの目安は見えてきたかと思います。しかし、実際に生成を繰り返すと「形は完璧だけれど、なんだか絵が硬い」「質感は良いけれど、少し形がズレている」といった、新たな悩みに直面することがあります。

納得のいく1枚を仕上げるために、最後に知っておきたい「再現度」と「クオリティ」のバランスについてお伝えします。

- 「線」を優先するならCanny

元画像の形状を完璧に守ることができます。

一方で、AIが「線に縛られすぎる」ため、質感の描き込みが甘くなったり、全体的に少し硬い印象の絵になったりすることがあります。 - 「質」を優先するならDepth

形状に多少の「ゆらぎ」やズレが出ることがあります。

その代わり、AIが自由に筆を動かせる余白が生まれるため、光の当たり方や素材の質感など、絵としてのクオリティが上がりやすい傾向にあります。

「画質が少し落ちても、この形だけは死守したい」ならCanny。

「形が多少崩れても、とにかく綺麗な絵にしたい」ならDepth。

この視点を持つだけで、生成結果に対する納得感が格段に変わります。

OpenPoseの使い方:人体のポーズを精密に制御する

CannyやDepthが画像全体の構造を捉えるのに対し、このOpenPose(オープンポーズ)は「人体の骨格・関節位置」のみを抽出して固定するモデルです。

背景や服装の形状に縛られず、「ポーズだけ」を他のキャラクターや構図に移植したい時に、最も力を発揮します。

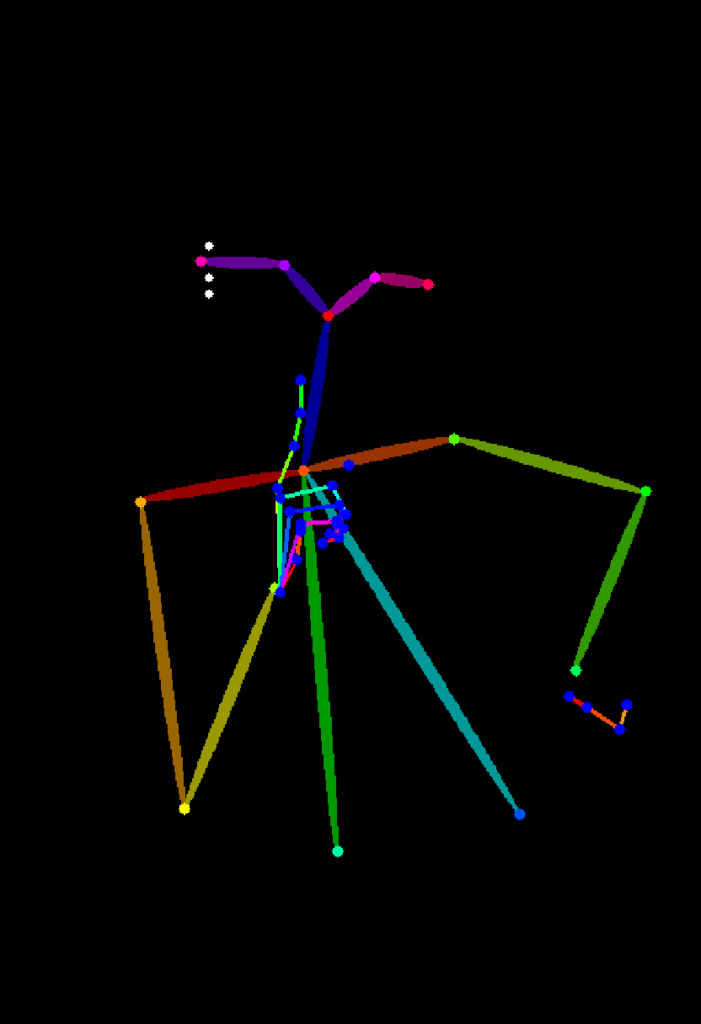

OpenPoseとは:骨格情報でポーズを固定する

OpenPoseは、画像から人物の頭、肩、肘、手首、膝などの関節位置を検出し、いわゆる「棒人間(ボーン画像)」のようなガイドラインを作成します。

CannyやDepthと決定的に違うのは、「背景や服装の情報を完全に無視できる」点です。

「このポーズは好きだけど、服装はプロンプトでガラッと変えたい」という時、OpenPoseを使えば背景のパースや服の形に引きずられることなく、ポーズだけを精密に再現できます。

おすすめの使いどころ

OpenPoseは「ポーズの使い回し」や「ポーズの固定」において、他のモデルの追随を許さない安定感があります。

| シーン | 具体的な効果 |

|---|---|

| ポーズの再現 | 参考画像のキャラクターが取っているポーズを、そのまま別キャラで生成する。 |

| バリエーション展開 | 同じポーズを維持したまま、衣装や背景だけを変えた差分画像を量産する。 |

| ポーズラフの活用 | 手書きの簡単な棒人間ラフを元に、理想のポーズでAI生成を行う。 |

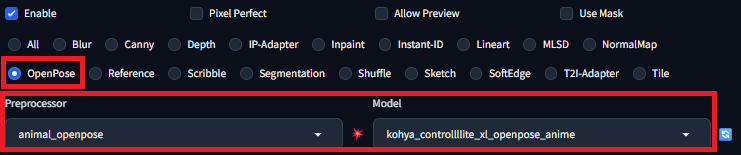

OpenPoseの実践手順

Forgeでの基本的な操作の流れです。

ControlNet Integrated のパネルを開きます。

まずここをONにします。設定を終えてもここを忘れると機能しないため、最初に行う習慣をつけましょう。

ポーズの参考にしたい画像をセットします。

画面上部の OpenPoseボタンを押します。これで、適切な Preprocessor と Model が一括で自動選択されます。

Preprocessorはデフォルトだと、animal_openposeが選択されますが、今回はより精度の高いdw_openpose_fullを使用します。どれを選択すべきかは後述するのでそちらを確認してください。

またModelは、Kohya_Controllllite_xl_openpose_animeを選択します。

今回は、以下の設定で進めます。

- Pixel Perfect:ON

- Allow Preview:ON

- Control Weight:1.0

- Timestep Range:0~1

- Control Mode:Balanced

- Resize Mode:Crop and Resize

プロンプトを入力し、「Generate」をクリックして結果を確認します。

元の画像

抽出した画像

【補足】どれを選ぶ?OpenPose – Preprocessorの種類と使い分け

OpenPoseには多くのプリプロセッサ(解析エンジン)が存在しますが、これらは「元画像から何を読み取るか」の範囲が異なります。用途に合わせて最適なものを選ぶことで、ポーズの再現度が劇的に変わります。

- dw_openpose_full(推奨)

- 抽出内容:体全体の骨格 + 顔のパーツ + 指先(高精度版)。

- 用途:現在の「正解」です。 全身のポーズ、表情、指の形まで最も精密に再現したい時に選びます。

- openpose_full

- 抽出内容:体全体の骨格 + 顔のパーツ + 指先。

- 用途:

dw_版が登場する前の標準設定です。基本はdw_版で良いですが、動作が重い場合の代替案になります。

- openpose

- 抽出内容:体全体の骨格(体幹、腕、足)のみ。

- 用途:「大まかな立ち姿だけ固定できればいい」という時に。指先や表情の制御を含まないため、その部分はAIの自然な描写力に任せることができます。

- openpose_face / openpose_faceonly

- 抽出内容:顔のパーツ位置(目、鼻、口、輪郭)のみ。

- 用途:「体はプロンプトで自由に変えたいけれど、視線や口角の上がり方だけは元画像に合わせたい」というピンポイントな制御に使います。

- openpose_hand

- 抽出内容:手の骨格・指先の関節のみ。

- 用途:複雑なハンドサインや、手に持った物の位置関係を固定したい時に。ただし、現在は

dw_openpose_fullで事足りることが多いです。

- animal_openpose

- 抽出内容:四足歩行の動物(犬、猫など)の骨格。

- 用途:人物の生成には使いません。 ペットなどの動物を、元画像と同じポーズで生成したい時にのみ選択します。

- densepose

- 抽出内容:骨格(線)ではなく、人体の表面(面)の幾何学的構造。

- 用途:骨格図よりもさらに厳密に「体の肉感やボリューム」を維持したい場合に。ポーズだけでなく、キャラクターの体格まで引き継ぎたい上級者向けです。

思い通りのポーズを取らせるコツと注意点

OpenPoseをより安定して使いこなすための、実戦的なアドバイスです。

- 「手」の認識精度を選ぶ

Preprocessorには、顔や指先まで細かく抽出するopenpose_fullと、体幹のみを追うopenposeなどがあります。- 指先まで固定したい場合、

openpose_fullを選択します。 - 指の形が崩れやすい場合、あえて通常の

openposeに切り替えて、指先の表現はAIの自然な描画に任せると、かえって綺麗に仕上がることがあります。

- 指先まで固定したい場合、

- 重みを上げすぎない

OpenPoseは人体の構造を強く縛るため、Control Weight を 1.0 以上に上げすぎると、キャラクターの体型が不自然に歪んだり、画質が極端に硬くなったりすることがあります。

基本は 0.8 〜 1.0 の範囲で調整するのが、自然な絵を作るコツです。 - 認識しやすい画像を選ぶ

OpenPoseは人体の骨格を推測するため、人物が一人で、かつ全身や関節が明確に映っている画像ほど精度が高まります。多人数や、体の一部が大きく隠れている画像では認識が不安定になるため、プレビュー(火花マーク)で「骨格が正しく取れているか」を事前に確認することが大切です。

応用:Hires.fix & ADetailerとの「最強フルコース」運用

ControlNet単体でも驚くべき成果が出ますが、実戦ではもう一歩先の「完成度」を求めたいもの。特に高解像度でイラストを書き出す際、ControlNetのポーズを維持しつつ、細部を破綻させないためには、周辺ツールとの連携が欠かせません。

ここでは、私が実際に運用している、「構図・ポーズの固定」「高解像度化」「顔・手の仕上げ」をワンストップで実現する「最強フルコース」のワークフローをご紹介します。

ControlNet → Hires.fix → ADetailerの流れ

ControlNet・Hires.fix・ADetailer。これらを単体で使うのも十分強力ですが、3つを正しい順序で組み合わせることで、生成効率とクオリティは劇的に向上します。

「ControlNet」の「Enable」にチェックを入れ、OpenPoseなどで構図を固定します。

次に「Hires.fix」のチェックを入れ、UpscalerやDenoising Strengthを設定します。これにより、生成と同時に「描き込みの強化」が予約されます。

最後に「ADetailer」のチェックを入れ、モデル(face_yolov8n.ptなど)を選びます。生成の最終工程で、顔や手を自動で検知して描き直してくれます。

Denoising Strengthの黄金比 0.45

フルコース運用において、最も頭を悩ませるのがHires.fixの「Denoising Strength(ノイズ除去強度)」のさじ加減です。

数値を上げれば書き込みは増えますが、上げすぎるとControlNetで必死に固定したはずのポーズが崩れてしまいます。試行錯誤の末に辿り着いた、推奨設定値がこちらです。

| 段階 | 推奨 Denoising Strength | 理由 |

|---|---|---|

| Hires.fix | 0.4〜0.5 | 筆者は0.45を基本値として使用。ControlNetで固定した構図を維持しつつ、高解像度化できる境界線。 |

| ADetailer(顔) | 0.4前後 | 元の顔の同一性を保ちつつ、まつ毛や瞳などの細部を仕上げる。 |

全設定値リファレンス表(コピペ・保存推奨)

この表は、Stable DiffusionのControlNetを「なんとなく」から「意図通り」に使うためのバイブルです。太字は初心者の方がまず設定すべき推奨値です。

共通設定値一覧

ControlNetの全モデルに共通する基本設定です。ここを間違えると、どんなに良いモデルを使っても効果が出ません。

| 設定項目 | 推奨値 | 役割 | 初心者向けの理由(なぜ?) |

|---|---|---|---|

| Enable | ON | 有効化 | チェックを入れないと機能しません。 |

| Pixel Perfect | ON | 解像度自動調整 | 生成サイズに合わせてAIが最適化してくれます。ボケやズレを防ぐため必須です。 |

| Allow Preview | ON | プレビュー許可 | プリプロセッサがどこを認識したか、生成前に確認できます。意図通りかチェックできます。 |

| Control Weight | 0.8〜1.0 | 効き目の強さ | 1.0だと指示が強すぎて不自然になることがあります。0.8に下げると「AIの表現力」が混ざり、少し自然な仕上がりになります。 |

| Timestep Range (Start) | 0 | 開始タイミング | 最初からガイドを読み込ませるのが基本です。基本は0でOK。 |

| Timestep Range (End) | 0.8〜1.0 | 終了タイミング | 0.8にするのがコツです。最後の2割をAIに自由に描かせることで、質感が自然になります。 |

| Control Mode | Balanced | バランス設定 | 基本はBalanced。ポーズを絶対に変えたくない時だけ「ControlNet is more important」を選択。 |

| Resize Mode | Crop and Resize | サイズ調整 | 元画像と生成サイズが違う場合、端をカットして構図を維持します。最も歪みが少ない設定です。 |

Canny・Depth・OpenPose別推奨設定値

モデルごとの特性と、「うまくいかない時の対処法」をセットにした決定版です。

| モデル名 | Preprocessor | Control Weight | Control Mode | 特記事項 |

|---|---|---|---|---|

| Canny (線画抽出) | canny | 0.8〜1.0 | Balanced | 輪郭が細かすぎる場合はしきい値を調整 |

| Depth (深度) | depth_anything | 0.8〜1.0 | Balanced | depth_midas より精度が高い |

| OpenPose (ポーズ) | dw_openpose_full | 0.8〜1.2 | ControlNet is more important | 複数人・遠景は精度が落ちる |

まとめ:ControlNetで「生成ガチャ」を卒業しましょう

ControlNetを使いこなすための「3つの使い分け」はこれだけです。

- 輪郭・形状を固定したい → Canny(線画で縛る)

- 空間・立体感を固定したい → Depth(奥行きで縛る)

- ポーズを固定したい → OpenPose(骨格で縛る)

最初は難しく感じるかもしれませんが、まずはOpenPoseで「狙い通りのポーズ」をビシッと決めてみることから始めるのがおすすめです。「指示がAIに100%伝わった!」という快感を一度味わうと、画像生成の楽しさは何倍にも膨れ上がります。

設定に迷ったら、ぜひこの記事のリファレンス表をいつでも見返してください。

このシリーズの関連記事

UruruAILab